Generative KI zur Analyse vertraulicher Unternehmensdaten

Wie Unternehmen von Generativer KI profitieren können

ChatGPT hat die Künstliche Intelligenz innerhalb kürzester Zeit salonfähig gemacht, indem sich jeder schnell und unkompliziert einen Zugang bei OpenAI einrichten und sich von den beeindruckenden Funktionalitäten und Fähigkeiten der Generativen Pretrained Transformer (GPT) sein eigenes Bild machen kann. Dabei beeindruckt vor allem die Präzision, mit der ein Großteil der gestellten Anfragen beantwortet wird.

Es stellt sich sehr schnell die Frage, wie Unternehmen von den neuen KI Technologien profitieren können? Denn die Einsatzgebiete von Generativen KI Modellen in Unternehmen sind vielfältig. Diese reichen von Anwendungen im Bereich des Kundenservice und des Kundendialogs, um beispielsweise für seine Kunden rund-um-die-Uhr erreichbar zu sein, indem Kundenanfragen automatisiert beantwortet werden können, über Speech2Text Anwendungen mit integriertem Übersetzungsdienst bis hin zur ChatGPT-artigen Abfrage- und Analysemöglichkeit des unternehmensinternen Datenschatzes. Im Status Quo sind öffentliche KI Services wie ChatGPT von OpenAI noch schwer vorstellbar im täglichen Unternehmenseinsatz: das liegt einerseits daran, dass den ChatGPT-Modellen die domänenspezifische Datengrundlage der Unternehmen fehlt, auf der anderen Seite Unternehmen ihren unternehmensinternen Datenschatz einem öffentlich verfügbaren KI Dienst aus verschiedenen Gründen (u.a. Datenschutz, Regulatorik, Wettbewerb) nicht zur Verfügung stellen können und wollen. Wir möchten in diesem Beitrag die Möglichkeiten aufzeigen, wie Generative KI Modelle zur Analyse vertraulicher Unternehmensdaten eingesetzt werden können und welche Optionen es für die Implementierung gibt – on-premise oder in privaten Clouds.

Generative KI für die Analyse vertraulicher Unternehmensdaten

Die Einsatzgebiete von Generativen KI Modellen sind mannigfaltig, was vor allem in den flexiblen Nutzungsmöglichkeiten der Generativen KI begründet liegt. So können Generative KI Modelle diskriminativ im Sinne einer "Discriminative AI“ eingesetzt werden, indem beispielsweise Fragen wie "handelt es sich bei der Kundenanfrage um eine Beschwerde oder eine Service-Anfrage?“ beantwortet werden können. Aber vor allem generative Fragestellungen im Sinne einer klassischen "Generative AI“ wie die dynamische Extraktion von Topics aus einer Kundenanfrage "Extrahiere die drei Top Keywords aus dem Text und gib nur eine Liste mit Keywords zurück, nutze das folgende Schema: Keyword 1, Keyword 2, Keyword 3“ können damit beantwortet werden. Unter Einbindung von unternehmensinternen und domänenspezifischen Daten wird die Präzision und Qualität von LLMs deutlich verbessert – ein “must-have“ für die Verlässlichkeit bei automatisch generierten Antworten. Darüber hinaus behalten Unternehmen bei einem eigenen Betrieb von LLMs on-premise oder in einer Private Cloud die komplette Datensouveränität, ohne der Gefahr ausgesetzt zu sein, dass sowohl Erzeuger als auch Besitzer der Daten die Kontrolle und damit den strategischen Wert ihrer Datenressourcen aus der Hand geben.

On-Premise Betriebsmodell

Eine Möglichkeit, Generative KI zur Analyse vertraulicher Unternehmensdaten einzusetzen, besteht darin, die Technologie on-premise zu implementieren. Bei dieser Methode werden LLMs und die dazugehörige Infrastruktur innerhalb des Unternehmensnetzwerks betrieben. Dieses Betriebsmodell bietet Unternehmen die maximale Kontrolle über ihre Daten und gewährleistet die Einhaltung interner Sicherheitsrichtlinien und -standards.

Die Vorteile einer On-Premise Implementierung liegen auf der Hand:

- Hohe Datensicherheit: Vertrauliche Unternehmensdaten bleiben innerhalb der Unternehmensgrenzen und unterliegen den strengen Sicherheitsmaßnahmen des internen Netzwerks.

- Hohe Flexibilität: Die Infrastruktur kann nach Bedarf erweitert oder angepasst werden, um den spezifischen Anforderungen des Unternehmens gerecht zu werden (v.a. relevant von Betreibern kritischer Infrastrukturen oder Unternehmen im besonderen öffentlichen Interesse).

- Niedrigere Latenz: Da die Datenanalyse vor Ort erfolgt, werden ggfls. Latenzzeiten minimiert, was eine schnellere Verarbeitung und Analyse ermöglicht.

Private Cloud Betriebsmodell

Alternativ zur On-Premise Implementierung können Unternehmen Generative KI Modelle für die Analyse vertraulicher Unternehmensdaten in einer privaten Cloud betreiben. Bei diesem Betriebsmodell werden die KI-Modelle und die erforderliche Infrastruktur in einer dedizierten Cloud-Umgebung gehostet, die ausschließlich vom Unternehmen selbst genutzt wird. Private Clouds bieten ähnliche Vorteile wie On-Premise Implementierungen, jedoch mit zusätzlichen Flexibilitäts- und Kostenvorteilen, wie z.B.

- Bessere Skalierbarkeit: Private Clouds ermöglichen es Unternehmen, Ressourcen nach Bedarf zu skalieren und die notwendigen Rechenkapazitäten je nach Anforderung anzupassen (z.B. On-Demand Nutzung von teuren GPU-Kapazitäten zum Zeitpunkt des Modell-Trainings).

- Kosteneffizienz: Durch die Nutzung einer privaten Cloud können Unternehmen Kosten für den Kauf und die Wartung eigener Infrastruktur sparen.

Implementierung von Generativer KI

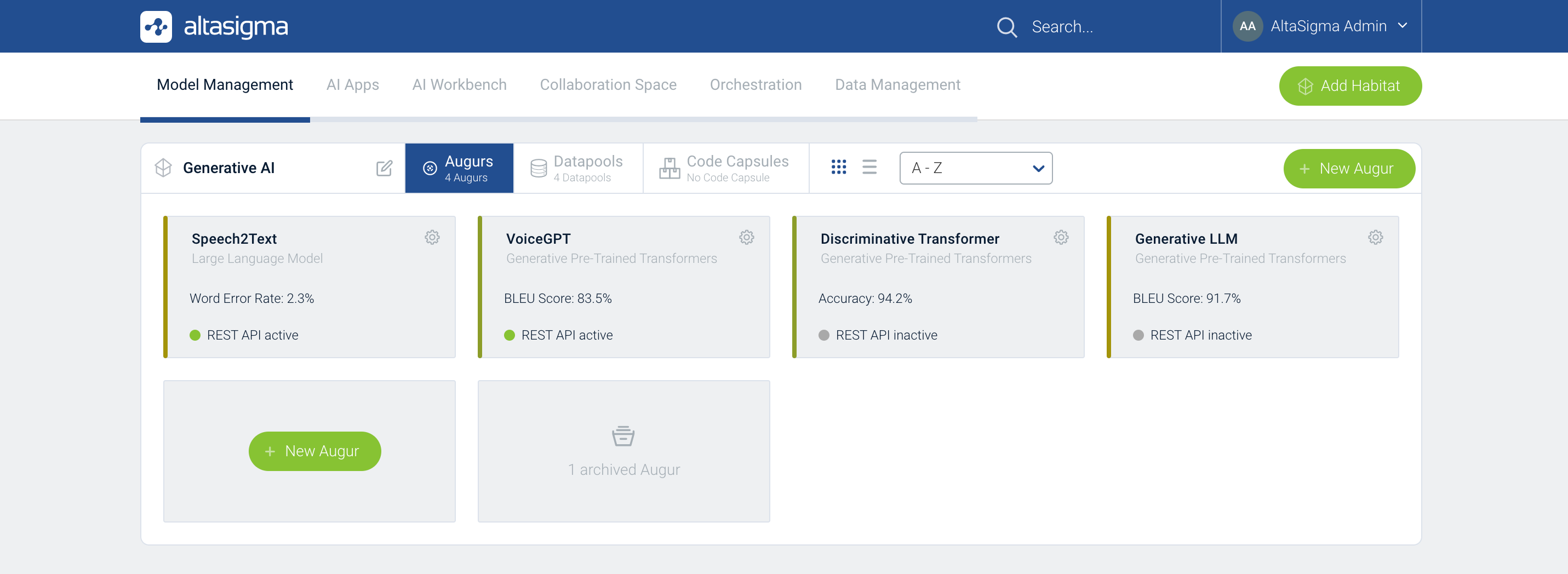

Für die Nutzung von Generativer KI aus on-premise oder Private Cloud Umgebungen heraus empfehlen sich sogenannte Enterprise AI Plattformen wie AltaSigma, welche alle relevanten Funktionalitäten für effizienten Betrieb von Generativen KI Modellen und deren Verknüpfung mit sensiblen Unternehmensdaten in einer integrierten Toolbox bereitstellen, u.a.

- Flexibles Chat UI zur Eingabe von Prompts, Visualisierung von Quellennachweisen und Konfidenz-Bewertung der Quellen,

- Model-Repositories zur Verwaltung von Generativen KI Basismodellen (zu beziehen u.a. bei Huggingface),

- Tools zur Erstellung von Retrieval Augmented Generation Pipelines (RAG) zur Abfrage von strukturierten und unstrukturierten Unternehmensdaten,

- Vektor-Datenbank zur Speicherung und Aktualisierung von Embeddings,

- Datenmanagement Funktionalitäten zur automatisierten Bereitstellung und Aufbereitung der relevanten unternehmens- und domänenspezifischer Daten,

- Transfer-Learning Funktionalitäten, um das unternehmens- und domänenspezifischer Wissen in die KI Basismodelle zu “injizieren“,

- MLOps Funktionalitäten für das Deployment und den Betrieb der Generativen KI Modelle,

- Standardisierte Abfrage- und Rückgabe-Schnittstellen (REST API) sowie

- Ausgefeiltes Rollen- und Rechte-Management zur Steuerung der Zugriffsrechte auf LLMs aber auch auf zugrundeliegende Unternehmensdaten.

Enterprise AI Plattformen bringen viele Funktionalitäten und Standards mit, damit die Potenziale von Generativen KI Modellen auch auf sensiblen Unternehmensdaten genutzt werden können, mit einer vergleichbaren Präzision und “Look & Feel“, wie man es von den kommerziellen Anwendungen wie ChatGPT gewohnt ist.

Zentrale Verwaltung von Generativen KI Modellen am Beispiel AltaSigma

FAQs zu Generativer KI für die Analyse vertraulicher Unternehmensdaten

Wie funktioniert Generative KI bei der Analyse von Unternehmensdaten?

Generative KI verwendet sog. Deep Learning Algorithmen, um Modelle zu trainieren, die neue Daten generieren können, die den ursprünglichen Daten ähneln. Diese generierten Daten können dann für nachgelagerte Analysen verwendet werden, um wertvolle Erkenntnisse zu gewinnen.

Welche Vorteile bietet eine On-Premise Implementierung gegenüber der privaten Cloud?

Die On-Premise Implementierung bietet Unternehmen eine bessere Kontrolle über ihre Daten und ermöglicht eine enge Integration mit bestehenden Systemen. Außerdem können spezifische Sicherheitsrichtlinien und -standards besser eingehalten werden.

Welche Vorteile bietet eine Private Cloud Implementierung?

Die Private Cloud bietet Unternehmen vor allem Flexibilität bei der Skalierung von Ressourcen sowie Kosteneinsparungen durch On-Demand-Nutzungsmöglichkeiten von teuren Rechenkapazitäten (v.a. GPU).

Wie kann Generative KI zur Analyse vertraulicher Unternehmensdaten beitragen?

Die Ausrichtung von Generativen KI Modellen auf unternehmens- und domänenspezifischen Daten ermöglicht Unternehmen, die Präzision und Qualität von Generativen KI Modellen deutlich zu steigern. Damit kann die Qualität und Verlässlichkeit von automatisierten Entscheidungen sowie die Identifizierung von Trends und Mustern deutlich verbessert werden.

Welche Sicherheitsmaßnahmen sollten bei der Nutzung Generativer KI für vertrauliche Unternehmensdaten ergriffen werden?

Es ist wichtig, angemessene Sicherheitsvorkehrungen zu treffen, um den Zugriff auf vertrauliche Daten zu kontrollieren, Verschlüsselungstechniken anzuwenden und strenge Zugriffs- und Authentifizierungsrichtlinien zu implementieren. Hierfür empfehlen sich Enterprise AI Plattformen.

Wie entwickelt man maßgeschneiderte generative KI-Modelle für die Unternehmensdatenanalyse?

Die Entwicklung maßgeschneiderter Generativer KI Modelle erfordert ein grundlegendes Verständnis der spezifischen Anforderungen des Unternehmens und umfangreiche Kenntnisse im Bereich des maschinellen Lernens. Enterprise AI Plattformen wie AltaSigma liefern alle Funktionalitäten, um die Entwicklung und den Betrieb der KI Modelle maximal ressourceneffizient zu ermöglichen.

Fazit

Die Nutzung Generativer KI zur Verarbeitung und Analyse vertraulicher Unternehmensdaten bietet Unternehmen die Möglichkeit, an den aktuellen KI Entwicklungen direkt zu partizipieren, mit dem Vorteil auf Basis des eigenen Datenschatzes wertvolle Erkenntnisse zu gewinnen und bessere automatisierte Geschäftsentscheidungen ableiten zu können. Sowohl die On-Premise Implementierung als auch Private Clouds bieten sichere und flexible Optionen für die Implementierung von Generativer KI, bei gleichzeitiger Sicherstellung der Datensouveränität. Bei der Auswahl des geeigneten Betriebsmodells sollten Unternehmen ihre spezifischen Anforderungen, Sicherheitsrichtlinien und die Integration mit bestehenden Systemwelten berücksichtigen. Durch eine richtige Nutzung Generativer KI auf eigenen Daten können Unternehmen ihren analytischen Reifegrad verbessern und die Qualität der Datenanalysen signifikant steigern, was sich positiv auf die aktuelle Wettbewerbssituation auswirken wird.